Open WebUI vs LM Studio

vs AnythingLLM : le comparatif 2026

Quatre interfaces pour faire tourner des LLMs en local. Après avoir testé les quatre en production, voici mon comparatif honnête.

Open WebUI : recommandé pour les power users et les équipes qui veulent auto-héberger une interface complète avec RAG, multi-utilisateurs et support MCP. LM Studio : recommandé pour les débutants et les individus qui veulent une app desktop simple, sans serveur.

AnythingLLM : recommandé pour les équipes avec budget support, RAG visuel et gestion de workspaces. Jan : recommandé pour le 100% offline strict. Pour une TPE/PME en France : Open WebUI auto-hébergé est le meilleur rapport fonctionnalités/contrôle/coût.

Comparatif complet des 4 outils

| Critère | Open WebUI | LM Studio | AnythingLLM | Jan |

|---|---|---|---|---|

| Type d’interface | Web (self-host) | Desktop native | Web + Cloud | Desktop native |

| Multi-utilisateurs | ✓ Natif | ✗ Mono | ✓ Cloud | ✗ Mono |

| RAG documents | ✓ ChromaDB | Beta 2025 | ✓ Visuel | ✗ Non |

| Support MCP | ✓ 2026 | ✗ | ✗ | ✗ |

| Courbe d’apprentissage | Moyenne | Douce | Douce | Très douce |

| Déploiement serveur | ✓ Docker | ✗ Desktop | ✓ Cloud | ✗ Desktop |

| Prix | Gratuit | Gratuit | Freemium | Gratuit |

| Idéal pour | Équipes tech | Débutants solo | Équipes non-tech | Confidentialité max |

Les 4 critères de choix qui comptent vraiment

Ergonomie au quotidien : LM Studio arrive en tête avec son interface desktop native, claire et immédiate. Open WebUI a une courbe d’apprentissage un peu plus longue mais une interface web accessible depuis n’importe quelle machine du réseau.

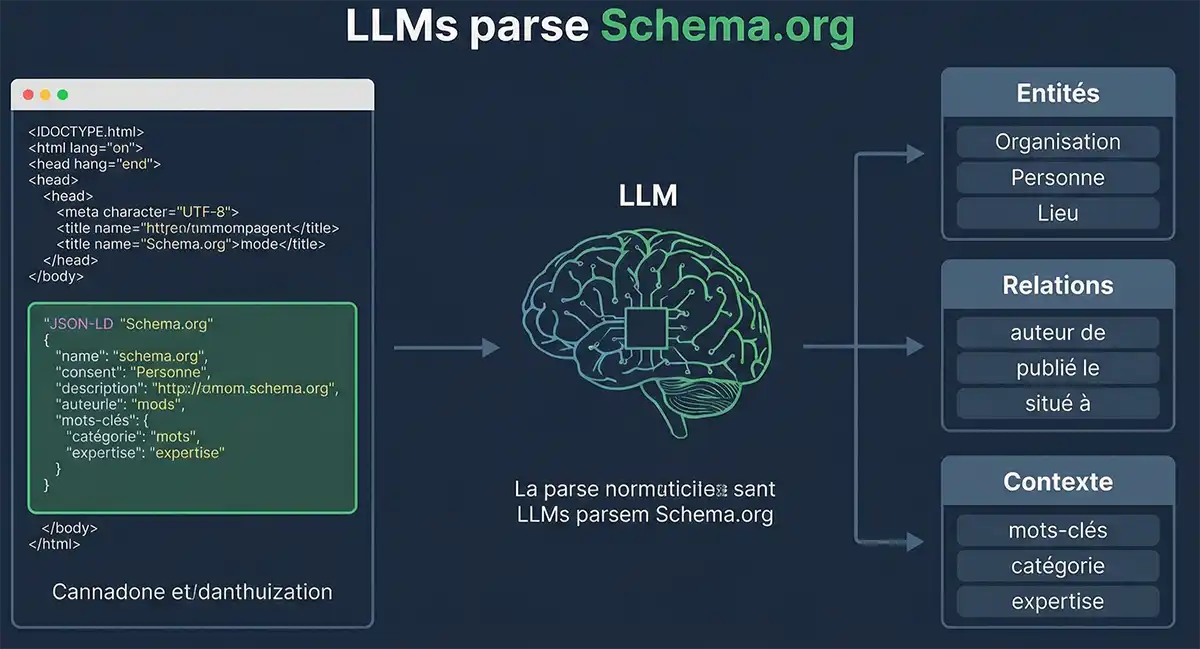

Fonctionnalités avancées : Open WebUI domine sur le RAG natif (ChromaDB, embeddings configurables), le support MCP (modèles de contexte via Model Context Protocol), et la gestion multi-utilisateurs. AnythingLLM est fort sur le RAG visuel et les workspaces.

Déploiement et maintenance : Docker sur un VPS pour Open WebUI et AnythingLLM, app desktop pour LM Studio et Jan. Docker est plus de travail initial mais zéro maintenance par la suite.

Coût total : tous les quatre sont gratuits en entrée. AnythingLLM a un Cloud payant. Les coûts réels viennent du serveur (Open WebUI, AnythingLLM auto-hébergé) ou des tokens API si vous connectez un backend cloud.

Mon verdict par profil

Vous débutez, usage solo, pas de budget serveur : LM Studio est parfait. Installation en 5 minutes, interface claire, modèles téléchargés en un clic. Montez sur Open WebUI quand vous aurez besoin de partager avec d’autres ou d’accéder depuis plusieurs machines.

Vous êtes une équipe de 2 à 20 personnes, compétences techniques internes : Open WebUI auto-hébergé sur un VPS. Contrôle total, multi-utilisateurs, RAG, support MCP. 2 heures d’installation, ensuite zero maintenance.

Vous êtes une équipe sans compétences techniques : AnythingLLM Cloud. Interface plus simple, support inclus, pas de serveur à gérer. Le trade-off : coût mensuel et données sur leurs serveurs.

Confidentialité maximale, pas de cloud : Jan pour le solo, Open WebUI en Docker local pour l’équipe.

J’utilise Open WebUI depuis sa version 0.3 et je le déploie pour des clients depuis début 2025. C’est l’outil le plus complet du marché pour les équipes techniques. La courbe d’apprentissage initiale est réelle mais elle vaut le coup — une fois configuré, c’est la solution qui évolue le mieux.

Le piège le plus fréquent : commencer par Open WebUI quand LM Studio aurait suffi. Si vous êtes seul et que vous voulez juste faire tourner des LLMs en local, LM Studio est 10× plus rapide à démarrer. Montez en complexité quand vous avez un vrai besoin de fonctionnalités avancées.

Construisons votre stack IA

Lucas Fonseque, consultant SEO & IA à Toulouse. 30 minutes pour identifier les bons outils selon votre profil — sans engagement.