Open WebUI · RAG · 2026

Open WebUI RAG

interroger vos documents internes en 2026

Connecter vos PDF, Word et CSV à un LLM local pour obtenir des réponses sourcées, sans envoyer vos données dans le cloud.

ChromaDB

Base vectorielle

nomic-embed-text

Embedding par défaut

ℹ️Réponse directe — Open WebUI RAG 2026

Le RAG d’Open WebUI permet d’interroger vos documents locaux (PDF, Word, Markdown, CSV, images) via un LLM. Pipeline : vos fichiers sont découpés en chunks, transformés en vecteurs via nomic-embed-text (par défaut), stockés dans ChromaDB. Vos questions récupèrent les chunks pertinents et les injectent dans le prompt du LLM.

Tout reste sur votre machine. Pour du contenu français, passez à bge-m3 ou multilingual-e5-large pour de meilleures performances d’embedding. Chunk size par défaut : 1500 tokens. Compatible avec les LLMs Ollama locaux et les APIs cloud OpenAI-compatibles.

Comment fonctionne le RAG dans Open WebUI ?

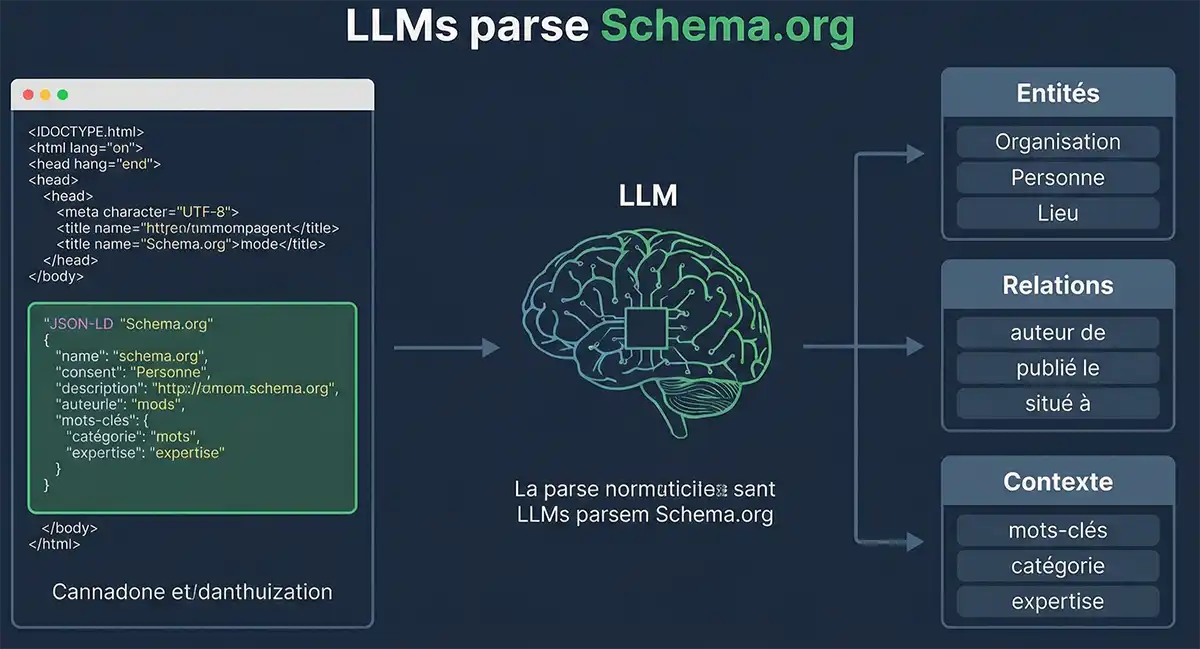

Le RAG (Retrieval-Augmented Generation) d’Open WebUI transforme vos documents en une base de connaissances interrogeable. Le processus se déroule en 4 étapes : vos fichiers sont chargés par des parsers qui extraient le texte (loaders), découpés en morceaux de 1500 tokens avec léger chevauchement (chunking), transformés en vecteurs mathématiques (embeddings), puis stockés dans ChromaDB.

Quand vous posez une question, Open WebUI convertit votre question en vecteur, cherche les chunks les plus proches dans ChromaDB, et injecte ces chunks dans le prompt du LLM pour qu’il génère une réponse sourcée. Tout ce pipeline tourne en local — rien ne quitte votre machine si vous utilisez Ollama.

La version 2026 d’Open WebUI supporte nativement : PDF, Word (.docx), Markdown, texte brut, CSV, et images via modèles de vision. Le modèle nomic-embed-text est l’embedding par défaut, mais vous pouvez configurer mxbai-embed-large, bge-m3, gte-base via Ollama, ou des API externes OpenAI-compatibles.

Configurer le RAG dans Open WebUI

1

Installer le modèle d’embedding

5 min

Dans votre terminal : ollama pull nomic-embed-text (ou bge-m3 pour un meilleur support du français). Ce modèle est distinct du LLM principal — il sert uniquement à créer les vecteurs.

2

Configurer dans Open WebUI

5 min

Allez dans Admin Panel → Documents. Vérifiez que le modèle d’embedding correspond à ce que vous avez installé. Chunk Size : 1500 (défaut), Chunk Overlap : 100. Ces valeurs fonctionnent bien pour la majorité des cas.

3

Créer une collection

2 min

Dans l’interface principale, cliquez sur l’icône document → Knowledge → New Knowledge. Donnez un nom à votre collection, une description, et uploadez vos premiers fichiers.

4

Connecter à une conversation

1 min

En démarrant une nouvelle conversation, sélectionnez votre collection via l’icône + ou en commençant par # dans la barre de saisie. Open WebUI affiche les sources utilisées dans chaque réponse.

5

Optimiser les résultats

En continu

Si les réponses sont imprécises, ajustez le nombre de résultats (Top-K, défaut 5), le chunk size (plus petit = plus précis mais plus fragmenté), et testez un modèle d’embedding multilingue si votre contenu est en français.

Les 4 cas d’usage RAG les plus utiles en TPE/PME

Base de connaissances interne : uploadez vos procédures, politiques RH, guides produits. Tous vos collaborateurs peuvent interroger cette base via le chat. Fini de chercher dans 200 PDF pour retrouver la politique de remboursement des frais.

Analyse de contrats et documents juridiques : chargez vos contrats et interrogez-les en langage naturel. ‘Dans ce contrat, quelle est la clause de résiliation ?’ retourne la clause exacte avec sa localisation dans le document.

Support client et FAQ : connectez votre documentation produit et laissez le LLM répondre aux questions clients en citant les sources exactes. Réducteur de tickets support pour des questions déjà documentées.

Recherche dans des archives : des années de rapports, emails ou notes dans un dossier ? Le RAG permet d’interroger tout ça en langage naturel, ce qu’aucun moteur de recherche plein texte classique ne peut faire avec la même précision sémantique.

💡Mon verdict

J’utilise le RAG d’Open WebUI pour ma documentation interne et mes archives de veille SEO/IA. La qualité des réponses est bluffante sur des documents bien structurés. Sur des PDF scannés ou des documents avec beaucoup de tableaux, les résultats sont moins bons — l’OCR n’est pas parfait.

Mon conseil pratique : commencez avec 10 à 20 documents bien structurés (pas des scans) pour valider que le RAG répond à vos besoins avant de scaler. La qualité des documents source est le facteur numéro 1 de la qualité des réponses — garbage in, garbage out.

Questions fréquentes sur Open WebUI RAG 2026

Quels formats de fichiers le RAG d’Open WebUI supporte-t-il ?+

Open WebUI RAG supporte nativement en 2026 : PDF (y compris multi-pages), Word (.docx et .doc), Markdown (.md), texte brut (.txt), CSV et fichiers tabulaires, et les images via les modèles de vision (PNG, JPEG, WebP). Pour les images, un modèle vision comme llava ou minicpm-v doit être installé et configuré.

Les formats non supportés nativement : Excel (.xlsx), PowerPoint (.pptx), emails (.eml, .msg), et les PDF protégés par mot de passe. Pour Excel et PowerPoint, la solution est d’exporter en CSV ou PDF avant d’uploader. Pour les PDF protégés, vous devez retirer la protection en amont.

Un point important sur les PDF scannés (photographies de documents) : Open WebUI peut les ingérer mais la qualité de l’extraction dépend de la résolution du scan et de la qualité de l’OCR intégré. Pour des PDF scannés de mauvaise qualité, prétraitez avec un outil OCR externe (Tesseract, Adobe Acrobat) avant d’uploader dans Open WebUI.

Quelle différence entre nomic-embed-text et bge-m3 pour le RAG ?+

nomic-embed-text est le modèle d’embedding par défaut d’Open WebUI. Il est rapide, léger (environ 274 MB), et donne de bons résultats sur l’anglais. Sur le français, il est correct mais pas optimisé — il a été entraîné majoritairement sur des données anglophones.

bge-m3 est un modèle d’embedding multilingue développé par le Beijing Academy of AI. Il est plus lourd (600 MB environ) mais offre des performances nettement meilleures sur le français et les autres langues non-anglophones. Si votre base documentaire est majoritairement en français, bge-m3 est le meilleur choix. L’alternative multilingual-e5-large est également excellente sur le français.

Pour changer de modèle d’embedding dans Open WebUI : Admin Panel → Documents → Embedding Model → sélectionnez votre nouveau modèle. Attention : changer le modèle d’embedding nécessite de réindexer tous vos documents existants — les vecteurs générés par nomic-embed-text ne sont pas compatibles avec bge-m3. Prévoyez le temps de réindexation selon la taille de votre base.

Comment améliorer la qualité des réponses RAG ?+

Trois leviers principaux. Premier levier : la qualité des documents source. Des documents bien structurés avec des titres clairs, des paragraphes courts et du texte extractible (pas des scans) donnent systématiquement de meilleurs résultats. Reformater vos documents avant de les ingérer est souvent plus efficace que toute optimisation de paramètres.

Deuxième levier : les paramètres de chunking. La taille par défaut de 1500 tokens fonctionne bien pour des textes continus. Pour des FAQ ou des procédures avec des réponses courtes, réduisez à 500-800 tokens pour des chunks plus précis. Pour des textes longs avec des idées qui s’étalent sur plusieurs paragraphes, montez à 2000-2500 tokens pour capturer le contexte.

Troisième levier : le nombre de chunks récupérés (Top-K). Le défaut est 5 chunks. Si vos réponses manquent de contexte, montez à 7 ou 10. Si les réponses mélangent des informations non liées, descendez à 3. Ajustez selon votre cas d’usage — une FAQ courte n’a pas besoin des mêmes paramètres qu’une analyse de contrat long.

Le RAG Open WebUI fonctionne-t-il hors ligne ?+

Oui, complètement. C’est l’un des avantages majeurs par rapport aux solutions RAG cloud. Si vous utilisez Ollama avec des modèles téléchargés en local, le pipeline RAG complet (embedding, stockage ChromaDB, LLM) tourne entièrement sur votre machine sans connexion Internet.

Les seules dépendances réseau potentielles : si vous configurez Open WebUI pour utiliser une API externe (OpenAI, Groq, Together AI) comme backend LLM ou d’embedding, ces appels sortent de votre réseau. Mais si vous êtes 100% Ollama, vous pouvez couper Internet et tout continue de fonctionner normalement.

Pour les déploiements en environnement ultra-sécurisé ou air-gapped, Open WebUI + Ollama est la seule solution RAG sérieuse du marché en 2026 qui tourne entièrement hors ligne sans modification. Assurez-vous de télécharger tous vos modèles (LLM + embedding) avant de déconnecter le réseau.

Peut-on gérer des permissions d’accès aux documents dans Open WebUI ?+

Oui, Open WebUI propose un système de permissions sur les collections de documents. Chaque collection peut être configurée en : privée (accessible uniquement au créateur), partagée avec un groupe d’utilisateurs, ou publique (accessible à tous les utilisateurs du serveur).

La gestion des groupes se configure dans Admin Panel → Users → Groups. Vous créez des groupes (ex: ‘Comptabilité’, ‘Support’, ‘Direction’), assignez des utilisateurs à ces groupes, et donnez l’accès à des collections spécifiques à chaque groupe. La collection ‘Archives comptables’ visible uniquement par le groupe Comptabilité, la collection ‘FAQ produit’ accessible à tous.

Pour les équipes de plus de 50 utilisateurs, la gestion des permissions devient plus complexe à maintenir. La recommandation est de créer des collections thématiques plutôt que par utilisateur, et de limiter le nombre de groupes à ce qui est réellement nécessaire. Une structure simple (3 à 5 groupes maximum) est bien plus maintenable qu’une structure granulaire à 20 groupes.

Combien de documents peut-on mettre dans une collection RAG ?+

Il n’y a pas de limite technique documentée sur le nombre de documents dans une collection Open WebUI. En pratique, j’ai testé des collections de 500 documents PDF sans problème de performance notable sur un laptop avec 16 GB de RAM. Au-delà de 2000 documents, les temps de réindexation et de recherche peuvent devenir perceptibles.

La limite pratique est souvent liée à la RAM disponible. ChromaDB charge les index en mémoire pour des recherches rapides. Une collection de 1000 documents moyens (200 pages chacun) peut consommer 2 à 4 GB de RAM selon le modèle d’embedding. Sur une machine avec 16 GB, vous avez de la marge confortable.

Pour de très grandes bases documentaires (10 000+ documents), envisagez de diviser en collections thématiques plus petites plutôt qu’une collection monolithique. La recherche dans des collections ciblées est plus précise et plus rapide qu’une recherche dans une immense collection fourre-tout.

Open WebUI RAG supporte-t-il les URLs et pages web ?+

Oui, Open WebUI peut ingérer le contenu de pages web via l’URL directement dans l’interface RAG. Entrez l’URL dans la zone d’upload de document, et Open WebUI va fetcher le contenu de la page, l’extraire et l’indexer comme n’importe quel autre document.

La qualité de l’extraction dépend de la structure de la page web. Les pages avec du contenu textuel propre (articles de blog, documentation technique) donnent de bons résultats. Les pages très chargées en JavaScript dynamique ou en contenu interactif peuvent donner des extractions incomplètes, car Open WebUI extrait le HTML statique sans exécuter le JavaScript.

Pour les sites qui nécessitent une authentification ou qui bloquent les bots, l’extraction directe par URL ne fonctionnera pas. La solution est d’exporter le contenu en PDF ou Markdown depuis votre navigateur puis d’uploader le fichier. Pour les documentations techniques, beaucoup de sites proposent une version PDF téléchargeable qui s’intègre parfaitement dans le RAG.

Comment sauvegarder et restaurer la base RAG d’Open WebUI ?+

La base RAG d’Open WebUI est stockée dans le volume Docker nommé open-webui. Pour sauvegarder, utilisez : docker run –rm -v open-webui:/source -v $(pwd):/backup busybox tar czf /backup/open-webui-backup.tar.gz /source. Cette commande crée une archive complète qui inclut les vecteurs ChromaDB, vos fichiers uploadés et toute la configuration.

Pour restaurer : créez un volume vide, décompressez l’archive dans ce volume, puis relancez le conteneur Open WebUI qui pointe sur ce volume restauré. La restauration prend quelques minutes selon la taille de la base. Vos collections, documents et conversations sont entièrement récupérés.

Pour la production, scriptez cette sauvegarde en cron quotidien avec rotation sur 30 jours, et copiez les archives vers un stockage externe (S3, Backblaze B2, ou un NAS local). En cas de perte du serveur, vous pouvez recréer toute votre base RAG en 15 minutes depuis la dernière sauvegarde.

Open WebUI RAG est-il adapté pour le français ?+

En 2026, Open WebUI RAG fonctionne très bien en français sous conditions. Le modèle d’embedding par défaut nomic-embed-text donne des résultats corrects sur le français, suffisants pour de nombreux usages. Pour des performances optimales sur du contenu exclusivement ou majoritairement français, bge-m3 ou multilingual-e5-large sont les meilleurs choix.

Pour le LLM qui génère les réponses, Mistral 7B est la meilleure référence francophone en local en 2026. Llama 3.3 70B (nécessite une machine puissante) et Qwen 2.5 32B sont également très bons en français. Évitez les modèles plus anciens ou trop petits qui ont des faiblesses notables en français.

Un conseil pratique pour le RAG en français : lors de l’upload de documents, assurez-vous que l’encodage est UTF-8 (c’est le cas pour les PDF modernes mais peut poser problème pour d’anciens fichiers Word). Les problèmes d’encodage se traduisent par des caractères mal interprétés dans les chunks, ce qui dégrade la qualité des embeddings et des réponses.

RAG Open WebUI vs RAG cloud (OpenAI Assistants, Notion AI) : quand choisir quoi ?+

Open WebUI RAG est recommandé quand : la confidentialité des documents est critique (données clients, brevets, documents RH sensibles), vous avez un volume important de documents à moindre coût (pas de token billing sur les embeddings locaux), vous voulez un contrôle total sur l’infrastructure et les données, ou votre organisation a des contraintes légales sur la localisation des données (RGPD, secteur médical, défense).

Les solutions RAG cloud (OpenAI Assistants, Anthropic avec Claude Projects, Notion AI) sont recommandées quand : la simplicité de déploiement prime sur la confidentialité (pas de serveur à gérer), vous avez de petits volumes de documents et un budget, la qualité des modèles cloud est nécessaire pour votre cas d’usage, ou vous n’avez pas de ressources techniques pour maintenir l’infrastructure.

Pour les TPE et PME françaises, le facteur décisif est souvent le RGPD : si vos documents contiennent des données personnelles de clients ou d’employés, les envoyer vers des serveurs américains peut poser des problèmes de conformité. Open WebUI RAG sur un serveur en France élimine ce risque entièrement. Pour les cas sans contrainte réglementaire forte, les solutions cloud sont plus simples à démarrer.

🔗

Pour aller plus loin sur Open WebUI

⭐ Ce que disent mes clients

📰 Pour aller plus loin sur l’IA en 2026

Retrouvez-moi sur les réseaux

Analyses SEO, tests IA et veille Claude au quotidien.