Le 31 mars 2026, Anthropic a accidentellement rendu public l’intégralité du code source de Claude Code — son produit phare — via une erreur d’emballage sur npm. 512 000 lignes de TypeScript, 1 900 fichiers, plus de 41 500 copies en quelques heures. Voici ce qui s’est passé, ce que cela révèle, et ce que cela change pour l’industrie.

Comment une erreur d’une ligne a tout changé

Le 31 mars 2026, l’équipe d’Anthropic publie la version 2.1.88 de Claude Code sur le registre npm. La mise à jour est de routine. Sauf qu’un ingénieur a oublié d’exclure un fichier du package de production : un fichier source map de 59,8 Mo baptisé cli.js.map.

Ce type de fichier est normalement réservé au débogage interne. Son rôle est de relier le code minifié et obfusqué livré aux utilisateurs au code source TypeScript original, pour faciliter l’identification des bugs en développement. En production, il n’a rien à faire dans un package public. Mais il était là.

Ce fichier pointait vers une archive zip stockée sur le bucket Cloudflare R2 d’Anthropic — accessible publiquement, sans authentification. Chaofan Shou, chercheur en sécurité chez Solayer Labs, a repéré le problème et l’a signalé sur X. En quelques heures, le post dépassait 30 millions de vues. L’archive était copiée plus de 41 500 fois sur GitHub avant qu’Anthropic ne réagisse.

Anthropic a confirmé : « Il s’agissait d’un problème de packaging de version causé par une erreur humaine, pas d’une faille de sécurité. » Aucune donnée client, aucun identifiant, aucun poids de modèle n’ont été exposés. Mais l’intégralité de l’architecture de leur outil le plus lucratif venait de devenir publique en quelques minutes.

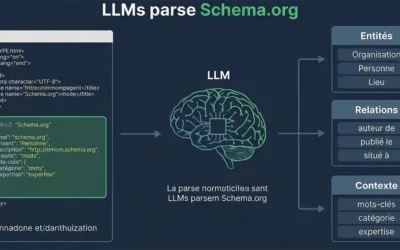

Ce que les développeurs ont trouvé dans le code

Le code exposé contenait 1 900 fichiers TypeScript représentant plus de 512 000 lignes de code — le cœur technique de Claude Code, l’assistant de développement en ligne de commande d’Anthropic qui avait atteint un run-rate de 2,5 milliards de dollars de revenus annuels en février 2026.

Des centaines de développeurs se sont immédiatement mis à analyser le contenu. Plusieurs révélations ont rapidement circulé dans la communauté technique.

Kairos : l’agent de fond non annoncé

Le code révèle l’existence de KAIROS, un système en arrière-plan autonome destiné à la consolidation de la mémoire entre les sessions. Aucunement disponible dans la version publique, ce système permettrait à Claude Code de maintenir une continuité contextuelle sur des projets de longue durée — un problème fondamental des assistants IA actuels. L’architecture de mémoire associée repose sur un système hiérarchisé à trois couches où les informations sont indexées, fragmentées et récupérées à la demande.

Le Coordinator Mode

Le code expose également un « Coordinator Mode » qui permettrait à Claude d’orchestrer plusieurs agents travaillant en parallèle sur un même projet. Cette fonctionnalité, non documentée publiquement, dessine une vision de Claude Code comme plateforme d’orchestration multi-agents — bien au-delà d’un simple assistant de codage.

L’Undercover Mode : la révélation la plus embarrassante

Parmi toutes les découvertes, c’est celle qui a provoqué le plus de réactions dans la communauté open source. L’Undercover Mode est activé automatiquement lorsque des employés d’Anthropic utilisent Claude Code pour contribuer à des dépôts publics — il efface automatiquement toutes les traces d’utilisation de l’IA dans les historiques de commits, sans possibilité de le désactiver manuellement.

En d’autres termes, Anthropic avait conçu un système pour que ses propres contributions à des projets open source ne puissent pas être identifiées comme assistées par l’IA. La communauté open source a jugé la pratique trompeuse, pointant le paradoxe d’une entreprise qui se présente comme championne de la transparence en IA.

Les easter eggs et les futurs modèles

Le code révèle également des références aux prochains modèles d’Anthropic sous les noms de code « Capybara » et « Fennec », correspondant à ce qui deviendra Claude 4.6 et Opus 4.6. Plus anecdotique mais symptomatique de la culture interne d’Anthropic : le code contient des Tamagotchis virtuels intégrés à la console de développement, avec 18 espèces et des variantes « shiny » rares, qui réagissent à la qualité du code produit.

8 000 demandes DMCA et la course perdue contre les copies

Anthropic a réagi rapidement en retirant la version 2.1.88 du registre npm. Mais le timing était défavorable. En quelques heures d’exposition, le dépôt avait été forké plus de 41 500 fois sur GitHub. Anthropic a lancé plus de 8 000 demandes de retrait DMCA pour tenter d’effacer les copies dispersées sur GitHub, Reddit et d’autres plateformes.

L’exercice est quasi-impossible. Ce qui a été distribué sur internet reste sur internet — c’est la leçon fondamentale de toute fuite numérique. Certains miroirs ont été repris en main pour héberger des réimplémentations « clean-room » en Python et Rust, conçues spécifiquement pour contourner les problèmes de droits d’auteur tout en reproduisant les fonctionnalités exposées.

Un contexte déjà fragilisé

Cette fuite ne s’est pas produite dans le vide. Elle intervient cinq jours après une autre erreur de configuration du CMS d’Anthropic, qui avait exposé environ 3 000 fichiers internes — dont un brouillon de billet de blog décrivant un modèle en développement présenté en interne comme soulevant des « risques de cybersécurité sans précédent ».

Deux fuites majeures en moins d’une semaine pour l’une des entreprises les mieux financées de l’IA mondiale. Et ce n’est pas la première fois que ce type d’erreur se produit chez Anthropic : une fuite de source map presque identique avait déjà touché Claude Code en février 2025, sur une version antérieure.

L’ironie de la situation n’a pas échappé aux observateurs. Anthropic est l’entreprise de l’IA qui se présente le plus systématiquement comme championne de la sécurité et de la responsabilité. Son positionnement commercial repose en partie sur la confiance que les entreprises lui accordent pour traiter leurs données sensibles. Deux incidents de sécurité majeurs en une semaine — causés non pas par des attaques sophistiquées mais par des erreurs de configuration basiques — interrogent les processus internes d’une organisation dont les outils sont activement utilisés pour écrire et déployer du code à grande échelle.

Ce que les concurrents vont faire de cette information

Le code exposé offre aux équipes techniques de OpenAI, Google, xAI et d’autres acteurs un accès direct aux implémentations spécifiques et aux optimisations de l’outil le plus performant d’Anthropic. Les bibliothèques de commandes slash, les outils intégrés, l’architecture de mémoire, les mécanismes anti-dérive contextuelle — autant d’innovations propriétaires qui représentent plusieurs années de R&D.

Des experts en cybersécurité ont également signalé un risque spécifique : la connaissance détaillée de l’architecture interne de Claude Code pourrait permettre à des acteurs malveillants de concevoir des payloads qui persistent entre les sessions longues, créant potentiellement un vecteur d’attaque via les environnements de développement des entreprises qui utilisent l’outil.

Les leçons pour tous les acteurs du digital

Au-delà du cas Anthropic, cet incident contient des enseignements universels pour toute organisation qui développe et distribue des logiciels.

La chaîne de publication npm est un vecteur d’exposition souvent sous-estimé. Une entrée manquante dans .npmignore ou dans le champ files de package.json — une erreur de quelques caractères — a suffi à exposer des années de propriété intellectuelle. L’automatisation des vérifications pré-publication (audit des fichiers embarqués, détection des source maps en production) est une mesure de sécurité basique que beaucoup d’équipes négligent.

La deuxième leçon concerne la gestion de crise. Anthropic a réagi en quelques heures avec une communication claire (confirmation de l’erreur humaine, réassurance sur les données clients, annonce de mesures correctives) et sans tentative de minimisation de l’incident. Cette transparence rapide a probablement limité les dégâts réputationnels, même si elle n’a pas pu limiter la diffusion du code.

Vous souhaitez comprendre comment l’évolution des outils IA transforme les pratiques de développement et de sécurité dans votre secteur ?