Le 10 mars 2026, le Pentagone a annoncé le déploiement de l’outil « Agent Builder » de Google, propulsé par Gemini, sur la plateforme GenAI.mil. Trois millions d’employés du Département de la Défense américain peuvent désormais créer leurs propres agents IA pour automatiser leurs tâches administratives. Deux jours plus tard, plus de 100 employés de Google envoyaient une lettre interne à Jeff Dean pour demander des garde-fous éthiques. La même semaine, Anthropic déposait plainte contre le Pentagone. Ce n’est pas un fait divers tech — c’est le début d’une reconfiguration majeure du pouvoir dans l’ère de l’IA.

Ce qui s’est passé exactement — les faits sans jargon

Commençons par le contexte factuel, parce que cette histoire est complexe et les raccourcis médiatiques l’ont parfois mal rendue.

Le Pentagone a lancé GenAI.mil en décembre 2025 — une plateforme d’IA générative interne pour les 3 millions d’employés du Département de la Défense (DoD). Les premiers outils disponibles étaient ceux de Google : Gemini for Government. En moins de deux mois, la plateforme avait dépassé 1,2 million d’utilisateurs uniques — un taux d’adoption spectaculaire pour une administration américaine habituellement lente à adopter les nouvelles technologies.

En mars 2026, Google a franchi un palier supplémentaire en déployant son outil « Agent Builder » sur GenAI.mil. Ce n’est plus seulement un chatbot — c’est un constructeur d’agents IA autonomes. N’importe quel employé du Pentagone, même sans compétences techniques, peut maintenant créer un agent capable d’exécuter des tâches multi-étapes : rédiger des comptes rendus, décomposer des projets, gérer des flux de travail administratifs. Le tout limité, pour l’instant, aux données non classifiées.

Emil Michael, sous-secrétaire à la Défense, a confirmé que des discussions sont en cours pour étendre l’outil aux systèmes classifiés. Google n’est pas seul : OpenAI a signé un accord similaire pour ChatGPT, et xAI d’Elon Musk a obtenu des accès pour Grok. Le contrat pilote global représente 200 millions de dollars répartis entre les quatre acteurs — Google, OpenAI, Anthropic et xAI.

Sauf qu’Anthropic n’est plus dans la course. La société a été désignée comme « risque pour la chaîne d’approvisionnement » par le Pentagone — une décision extraordinaire qui équivaut à une liste noire gouvernementale. La raison : Anthropic a refusé de signer des conditions d’utilisation qui auraient permis au DoD de déployer ses modèles pour de la surveillance de masse intérieure et des armes autonomes sans supervision humaine. Anthropic a déposé plainte contre le Pentagone en réponse.

Google en 2026 : la fin d’une décennie de principe

Pour comprendre l’ampleur du virage de Google, il faut remonter à 2018. Cette année-là, Google avait décroché une partie du contrat Maven — un programme du Pentagone utilisant l’IA pour analyser des images de drones militaires. La révolte interne avait été massive : des milliers d’employés avaient signé une pétition, une vingtaine avaient démissionné. Google avait finalement refusé de renouveler le contrat et publié des « AI Principles » — des principes éthiques interdisant explicitement les applications militaires létales.

En 2024, Google a licencié plus de 50 employés après des protestations contre le Projet Nimbus, un contrat de 1,2 milliard de dollars avec Amazon pour des services cloud au gouvernement israélien — y compris des outils d’IA pour des fabricants d’armes d’État. Les principes éthiques de 2018 avaient été maintenus officiellement, mais les contrats continuaient.

En 2025, ces principes ont été officiellement révoqués. La direction de Google a décidé que les « AI Principles » de 2018 étaient devenus un obstacle commercial. Le revirement a permis de décrocher une part du contrat pilote de 200 millions de dollars du DoD. Et en mars 2026, le déploiement d’Agent Builder sur GenAI.mil matérialise concrètement ce changement de direction.

Ce que je trouve frappant dans cette séquence, c’est la vitesse à laquelle une position qui semblait institutionnelle a été abandonnée dès que les enjeux commerciaux l’ont rendu gênante. Les « AI Principles » de Google n’étaient pas une contrainte réglementaire — c’était un engagement volontaire. Et les engagements volontaires face à des contrats gouvernementaux de plusieurs centaines de millions de dollars ont une durée de vie limitée.

La rébellion interne : 100 employés, une lettre à Jeff Dean

Le 1er mars 2026, plus de 100 employés de Google travaillant sur l’IA ont envoyé une lettre interne à Jeff Dean, le directeur scientifique de Google DeepMind. Leur demande : interdire au Pentagone de déployer Gemini pour la surveillance des citoyens américains et les armes autonomes sans contrôle humain.

La lettre est arrivée quelques jours après la décision du Pentagone de blacklister Anthropic, et quelques jours avant que Google ne déploie officiellement Agent Builder sur GenAI.mil. Le timing est significatif — les employés signataires savaient ce qui se préparait et ont agi avant l’annonce publique.

Une lettre similaire, intitulée « We Will Not Be Divided », a circulé plus largement — elle a réuni près de 900 signataires dont 800 de Google et 100 d’OpenAI. Cette lettre soutenait explicitement la position d’Anthropic et demandait à toutes les entreprises de refuser les conditions d’utilisation qui permettraient la surveillance de masse ou les armes entièrement autonomes.

Jeff Dean, le directeur scientifique de Google DeepMind, a pris une position personnelle sur X. Parlant en son nom propre, il a écrit que « la surveillance de masse viole le Quatrième Amendement et a un effet inhibiteur sur la liberté d’expression ». C’est une prise de position remarquable de la part d’un des cadres les plus senior de Google — mais elle reste une opinion personnelle, pas une politique d’entreprise.

Ce que cette rébellion révèle : les ingénieurs qui construisent ces systèmes ne sont pas unanimement enthousiastes à l’idée de les voir déployés par l’armée sans garde-fous. Et leur capacité à influencer les décisions stratégiques de leurs employeurs est limitée — mais non nulle. En 2018, la pression interne avait été suffisante pour tuer le contrat Maven. En 2026, le même type de mobilisation n’a pas eu le même résultat. La culture interne de Google a changé — et les incitations financières sont plus fortes.

Le cas Anthropic : quand refuser une ligne rouge coûte un contrat

L’histoire d’Anthropic dans ce dossier mérite d’être racontée correctement. La société a initialement fait partie des quatre bénéficiaires du contrat pilote de 200 millions de dollars. Mais elle a refusé de signer des conditions d’utilisation qui auraient permis au DoD de déployer Claude pour de la surveillance domestique de masse et des armes autonomes sans supervision humaine — deux usages qu’Anthropic considère comme des « lignes rouges » constitutives de son modèle de sécurité IA.

La réponse du Pentagone a été radicale : désigner Anthropic comme « risque pour la chaîne d’approvisionnement » — une classification normalement réservée à des entités étrangères suspectes ou à des fournisseurs défaillants. Anthropic a déposé plainte, arguant que cette désignation est illégale. Des centaines de travailleurs tech, dont des employés d’OpenAI, Salesforce et IBM, ont signé une pétition demandant au Congrès d’examiner si l' »utilisation de ces autorités extraordinaires contre une entreprise technologique américaine est appropriée ».

Le paradoxe : Anthropic était le partenaire le plus avancé sur la sécurité IA — précisément les garanties que l’armée devrait théoriquement vouloir. Mais le Pentagone en 2026, sous l’administration Trump, préfère la flexibilité à la sécurité encadrée. C’est un signal stratégique important sur les priorités réelles du gouvernement américain en matière d’IA militaire.

Ce que « non classifié » veut dire — et ce que ça ne veut pas dire

Google et le Pentagone ont insisté sur le fait que le déploiement actuel d’Agent Builder se limite aux données non classifiées. C’est vrai — et c’est important à préciser pour éviter les raccourcis alarmistes. Mais cette précision ne clôt pas le débat éthique pour plusieurs raisons.

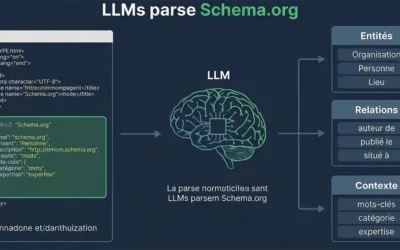

Premièrement, « non classifié » dans le contexte du Pentagone ne signifie pas « sans sensibilité ». Beaucoup de données opérationnelles, logistiques et de planification du DoD sont non classifiées mais restent stratégiquement sensibles. Un agent IA qui optimise les flux de ravitaillement militaire ou la planification des déploiements travaille sur des données « non classifiées » mais contribue directement à des capacités opérationnelles militaires.

Deuxièmement, Emil Michael a explicitement confirmé que des discussions sont en cours pour étendre Agent Builder aux systèmes classifiés. Le déploiement non classifié est une première étape, pas un point d’arrivée. Les utilisateurs de DefenseScoop et les analystes du Georgetown CSET — dont Emelia Probasco, citée dans plusieurs articles — ont noté que le chemin vers les systèmes classifiés semble tracer déjà.

Troisièmement, les agents IA au sens technique — des systèmes capables d’exécuter des actions multi-étapes de façon autonome — posent des questions fondamentalement différentes des chatbots. Un chatbot répond à des questions. Un agent IA prend des décisions et exécute des actions. Cette distinction est centrale dans le débat sur la supervision humaine des systèmes d’armement.

Pourquoi ce dossier compte pour la France et l’Europe

Ce qui se joue au Pentagone en mars 2026 n’est pas seulement une affaire américaine. Il y a plusieurs raisons pour lesquelles cette séquence devrait intéresser les décideurs européens et les professionnels du digital en France.

D’abord, le précédent normatif. Les conditions d’utilisation que le Pentagone cherche à imposer aux fournisseurs d’IA — surveillance domestique, armes autonomes sans supervision humaine — sont exactement les usages que le règlement européen sur l’IA cherche à encadrer ou à interdire. Si les grands modèles américains acceptent ces conditions pour le marché militaire US, quelle garantie ont les utilisateurs européens que ces mêmes capacités ne leur seront pas appliquées d’une façon ou d’une autre ?

Ensuite, la question de la souveraineté technologique. La France investit dans des champions IA nationaux — Mistral, et d’autres acteurs. L’histoire d’Anthropic au Pentagone illustre la vulnérabilité des entreprises qui dépendent de contrats gouvernementaux pour leur financement : refuser une « ligne rouge » peut coûter un contrat existant et ouvrir la voie à une désignation hostile. Une IA souveraine française ou européenne ne devrait pas se retrouver dans cette position de dépendance vis-à-vis d’un client gouvernemental qui peut la blacklister pour raisons éthiques.

Enfin, le signal envoyé aux investisseurs. La désignation d’Anthropic comme « risque pour la chaîne d’approvisionnement » est un signal de marché : les entreprises qui maintiennent des lignes rouges éthiques dures face aux gouvernements peuvent en payer le prix commercial. C’est une pression structurelle vers moins d’éthique dans l’IA — pas plus.

Mon analyse : la fin du mythe de l’IA éthique volontaire

Ce dossier confirme quelque chose que les chercheurs en gouvernance de l’IA disent depuis des années : les engagements éthiques volontaires des entreprises technologiques ne résistent pas aux pressions commerciales et gouvernementales suffisamment importantes.

Google a abandonné ses « AI Principles » de 2018. OpenAI a amendé ses conditions de contrat avec le Pentagone pour répondre aux demandes militaires. xAI d’Elon Musk n’a jamais prétendu avoir de garde-fous comparables. Seul Anthropic a maintenu ses lignes rouges — et en a payé le prix commercial immédiat.

Cela ne signifie pas que les efforts en matière d’IA responsable sont inutiles. Mais ça confirme que sans cadre réglementaire contraignant — pas des principes volontaires, mais des lois avec des sanctions — les incitations à maintenir des garde-fous éthiques face à des clients gouvernementaux puissants sont structurellement faibles.

C’est exactement la logique qui justifie le règlement européen sur l’IA : un cadre légal qui ne peut pas être abandonné comme Google a abandonné ses « AI Principles » en 2025. Mais ce cadre européen s’applique au marché européen, pas aux contrats militaires américains. La question de savoir comment les normes européennes peuvent influencer les pratiques mondiales des grandes entreprises tech reste ouverte — et urgente.

Pour les professionnels du digital et les entreprises qui utilisent des outils IA au quotidien, ce dossier a une implication pratique directe : évaluer vos fournisseurs IA non seulement sur leurs capacités techniques, mais sur leur gouvernance, leurs engagements éthiques, et leur résistance aux pressions externes. Un fournisseur qui abandonne ses principes face à un client gouvernemental puissant peut aussi modifier ses pratiques commerciales face à d’autres pressions.

Vous voulez structurer votre stratégie IA en tenant compte des enjeux de gouvernance et de souveraineté des données ? Échangeons.